外观

TRAE 支持自定义模型了,配置个 DeepSeek V4 试试

我感觉我被打脸了。

之前一直推崇 TRAE 的模型支持速度特别快,但这次 DeepSeek V4 已经出了好几天了,TRAE 的内置模型还没有支持上。

官方不支持,那我们只能自己动手了。

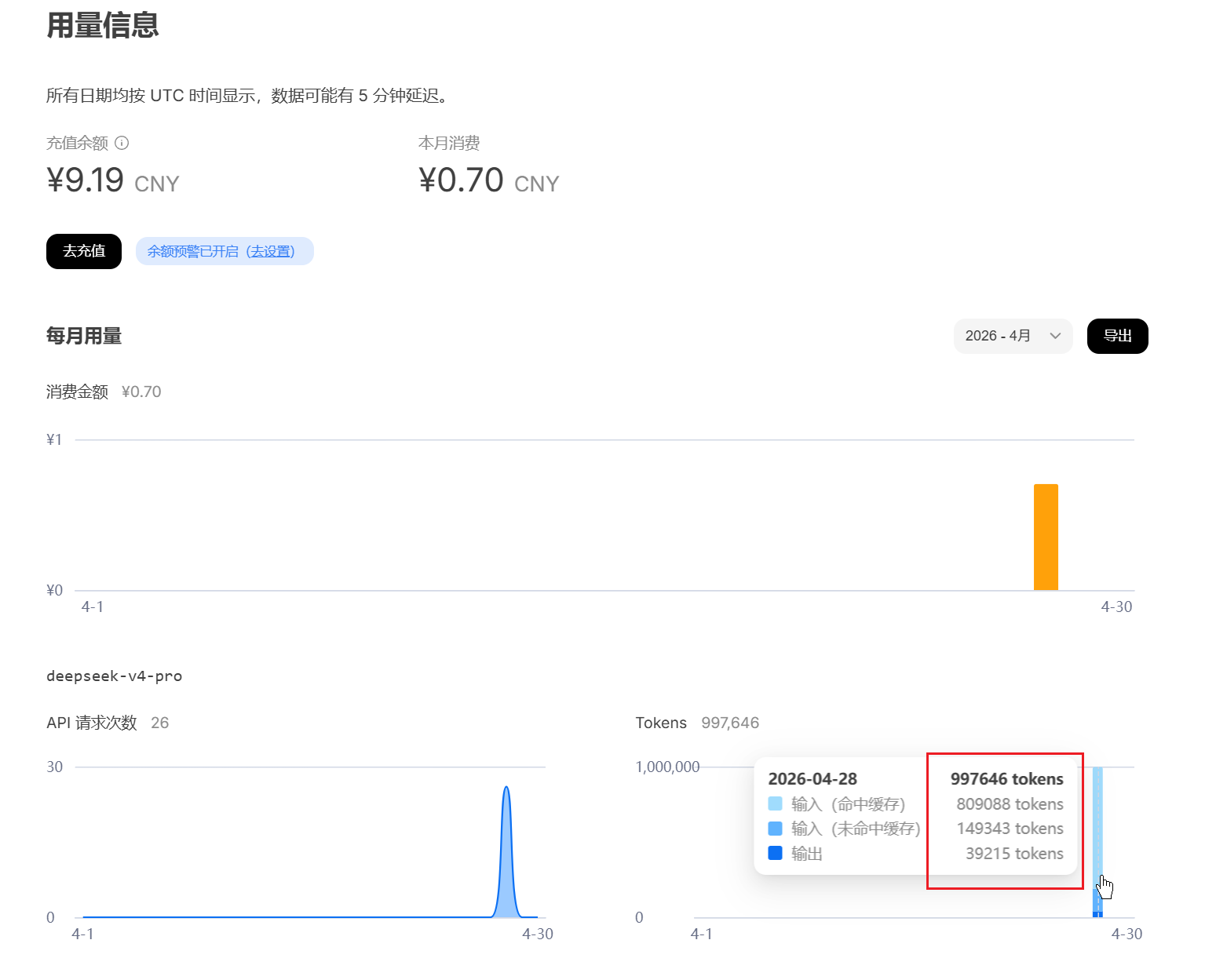

去年 DeepSeek 充的10块钱,还剩9块多,正好试一下。

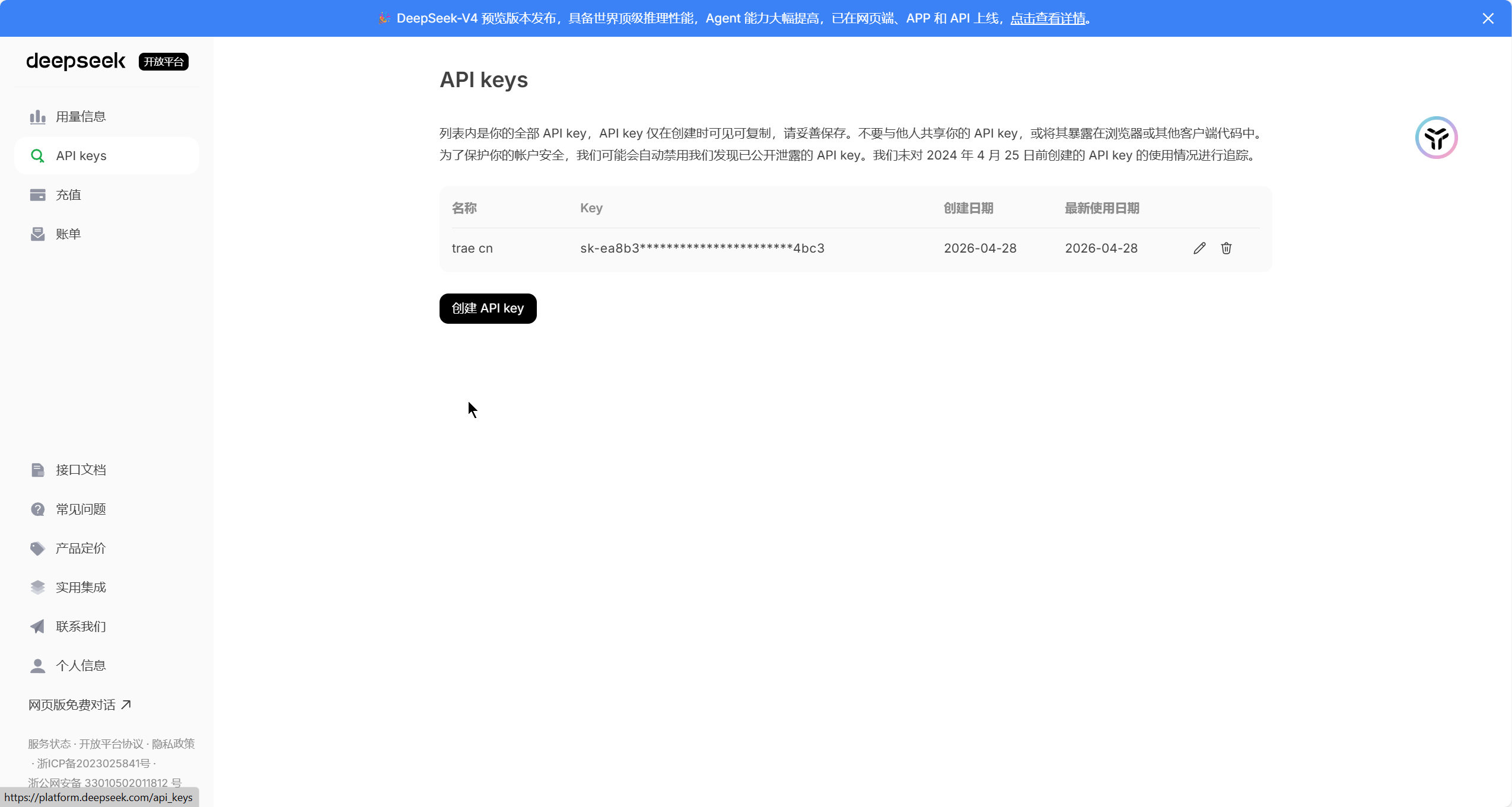

先登录 DeepSeek 开放平台,建立一个专用的 API key,这个 key 在后面会配置到 TRAE 里面。

务必保存好该 API key,因为生成后就无法看到了。

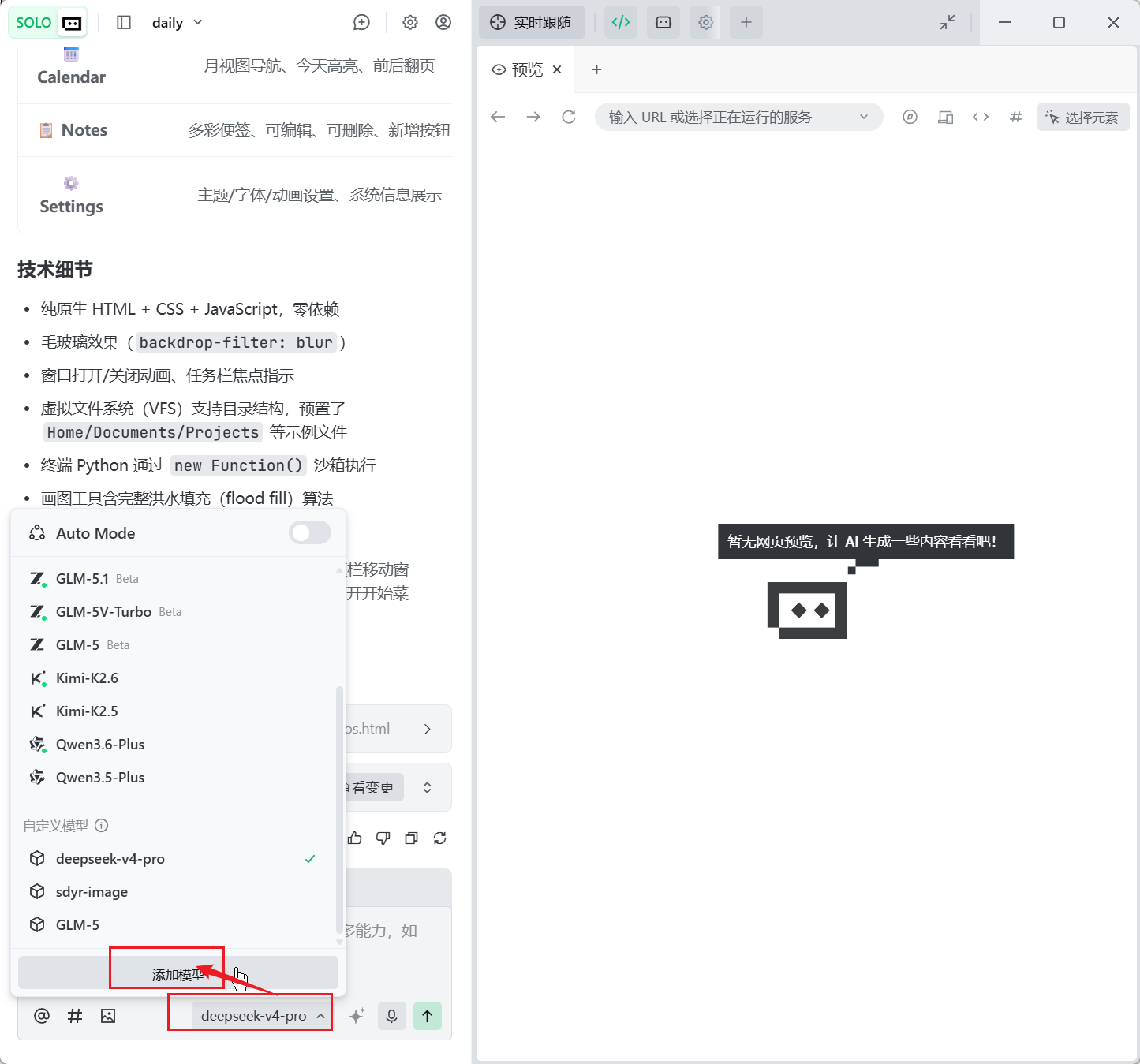

打开 TRAE,国际版和国内版都可以,自定义模型的操作也几乎一样。

在对话框下面点击"添加模型"。

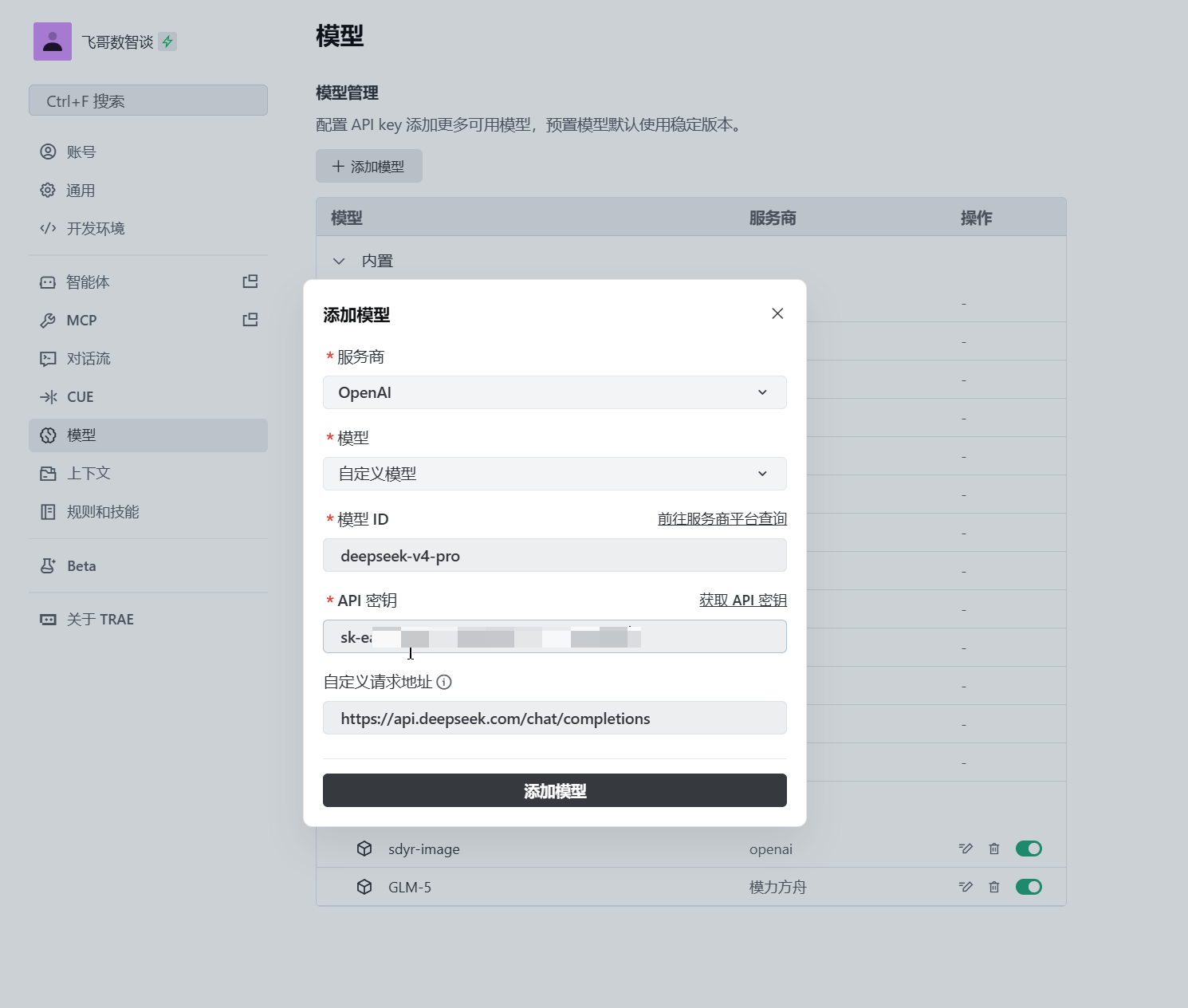

然后按照下图进行配置。

- 服务商选择

OpenAI。 - 模型选择"自定义模型"。

- 模型

ID填写deepseek-v4-flash或者deepseek-v4-pro,为了看看水平能到哪里,我选择了pro。 API密钥填写前面生成API key。- 自定义请求地址根据服务商填写不同的地址,我是

OpenAI,填写https://api.deepseek.com/chat/completions,如果服务商选择Anthropic,则填写https://api.deepseek.com/anthropic/chat/completions。

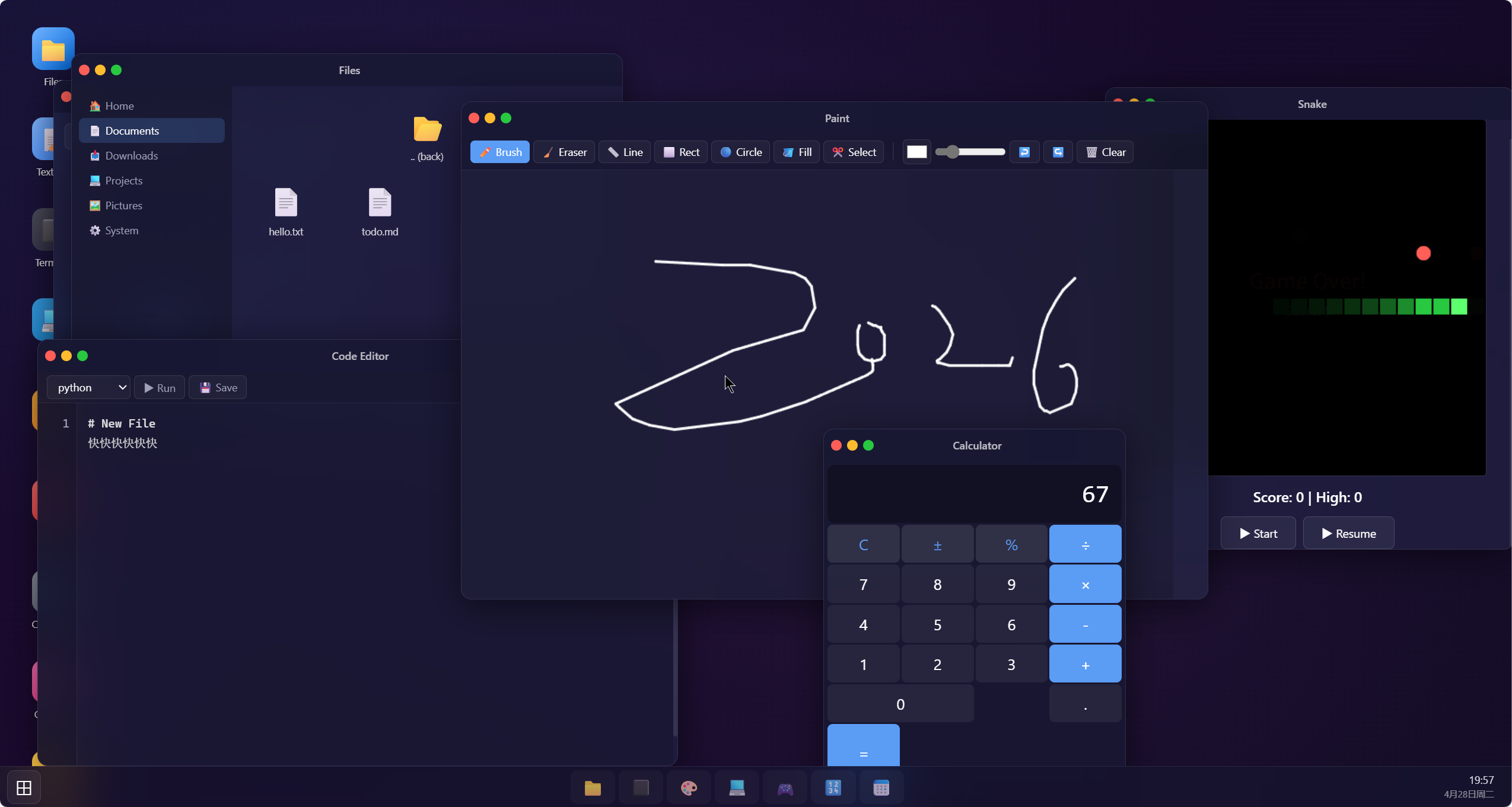

我们依然按照惯例,使用复刻 Windows 系统的场景进行首次体验。

设计并创建一个类似 Windows 操作系统的 Web OS,具备完整功能:从文本编辑器、带 Python 的终端、代码编辑器、可玩的游戏,到文件管理器、画图工具、视频编辑器,以及所有重要的 Mac OS 系统预装软件。可以使用任意库来实现。让整体效果有趣、细节丰富,呈现出超出常人预期的细节,在一个代码块中尽情发挥创意与美感。效果如下,整体架子没什么问题,但是 UI 感觉差了点意思,不是那么的还原。

但需要说明一点,虽然界面还原度不是特别高,但是基本应用的功能,比如绘图、游戏、编辑器功能都是完备的,比较符合大家对 DeepSeek 新版本理科生的认知。

网上说的特别便宜由于没有对比,先不聊太多,但是缓存命中这个,真的值得一提,粗略计算命中率 81%。

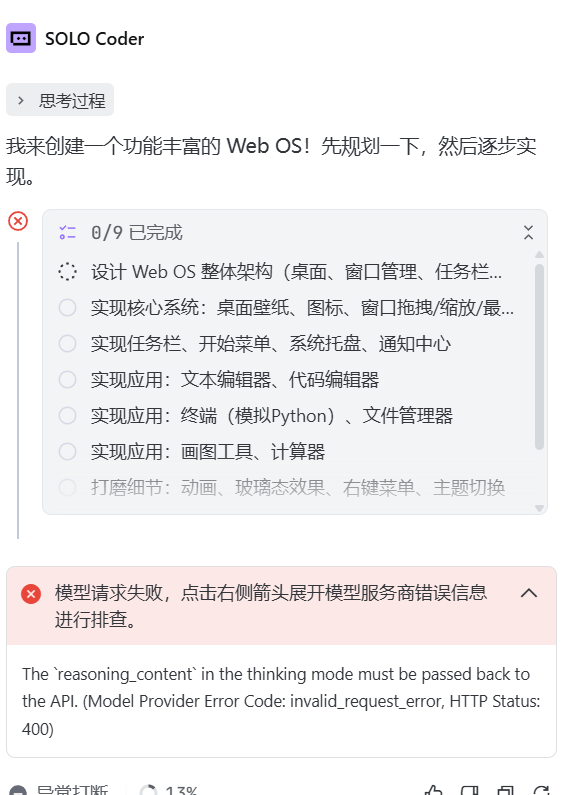

最后,分享一个容易出现的问题,错误信息见下图。

原因

当 DeepSeek 模型处于思考模式时,每一轮对话中模型返回的 reasoning_content(思维链内容)必须原样传回 API。TRAE IDE 目前尚未正确处理这个字段,在多轮对话中就会触发 400 错误。

解决方案

方案一:添加模型时,模型 ID 选择 deepseek-chat,该模型为 flash 非思考模式,可避免出现该错误。

方案二:如果对话中途出现该错误,可尝试新开对话,但该方案不保证有效。

方案三:尽量使用 TRAE CN,我的国际版尝试 3 次,每次必出该错误,但 TRAE CN 很少出现。