外观

深夜实测 DeepSeek 多模态:比 V4 重要,但色盲卡翻车了

早上起来就看到消息说 DeepSeek 支持多模态了,这消息我感觉比 V4 还要重要啊,但白天有点忙,没来得及尝试,只能晚上加班体验下了。

目前还在灰度中,有些小伙伴可能没有,那我就代劳了。

本来,我让 AI 帮我设计了几个常见图片识别的场景,从易到难,方便大家了解 DeepSeek 多模态的水平。

先给大家看下 AI 帮我生成的场景清单,计划分别使用非思考模式和思考模式尝试。

- 普通图片内容识别

- 文字

OCR - 图表解析

本来,我感觉这场景还挺有条理的, 循序渐进,并且覆盖了好几个问题类型。

但是~

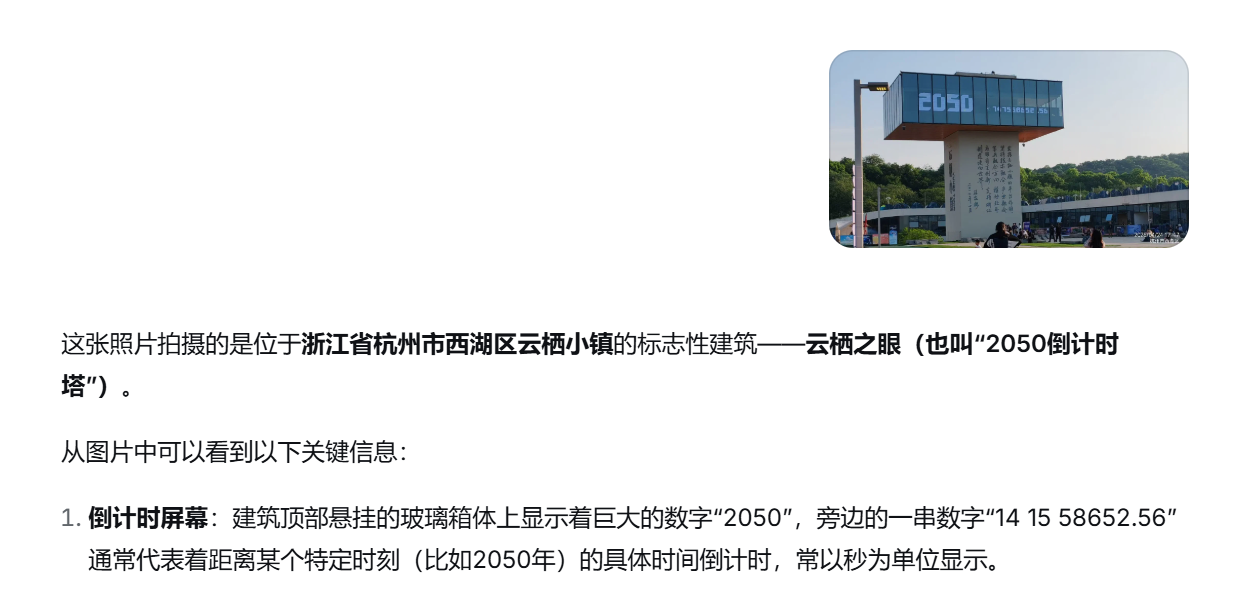

普通图片内容识别

非思考模式,内容理解没问题,图片右下角的时间也正确。

关键是它是在我点击完提交后,还没反应的情况下出来的结果。

非思考模式,称得上秒出。

文字 OCR

经典的艺术字体,使用非思考模式,这次不是秒出,是我还没眨完眼,结果输出完成了,当然,这个和输出内容少也有关。

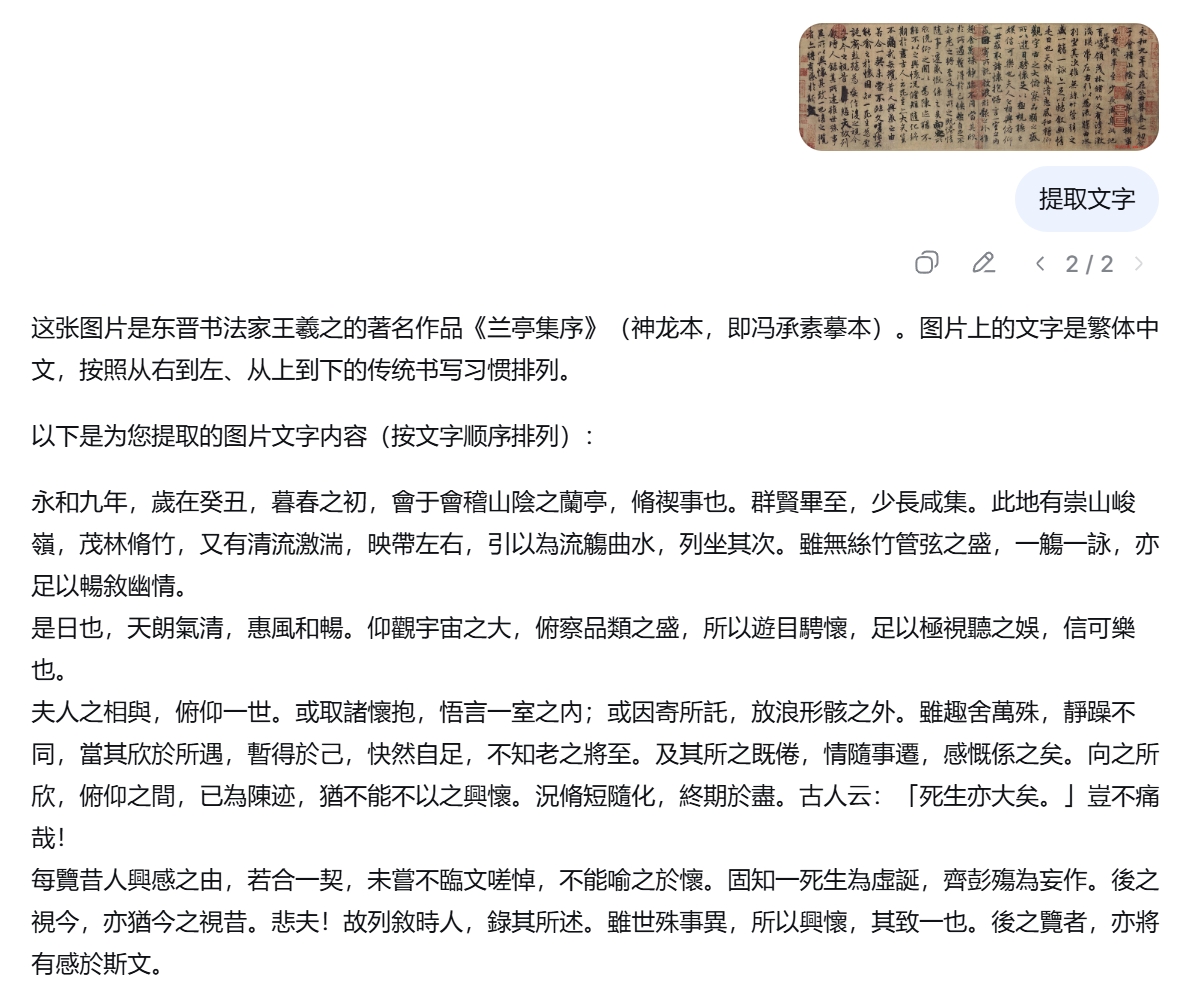

这么艺术的字体都识别这么快,我感觉验证不出来啥东西,就去找了《兰亭集序》。

嗯,我是服了。

文字 OCR 方面我已经找不出更难的了,因为再难,我自己也不认识了。

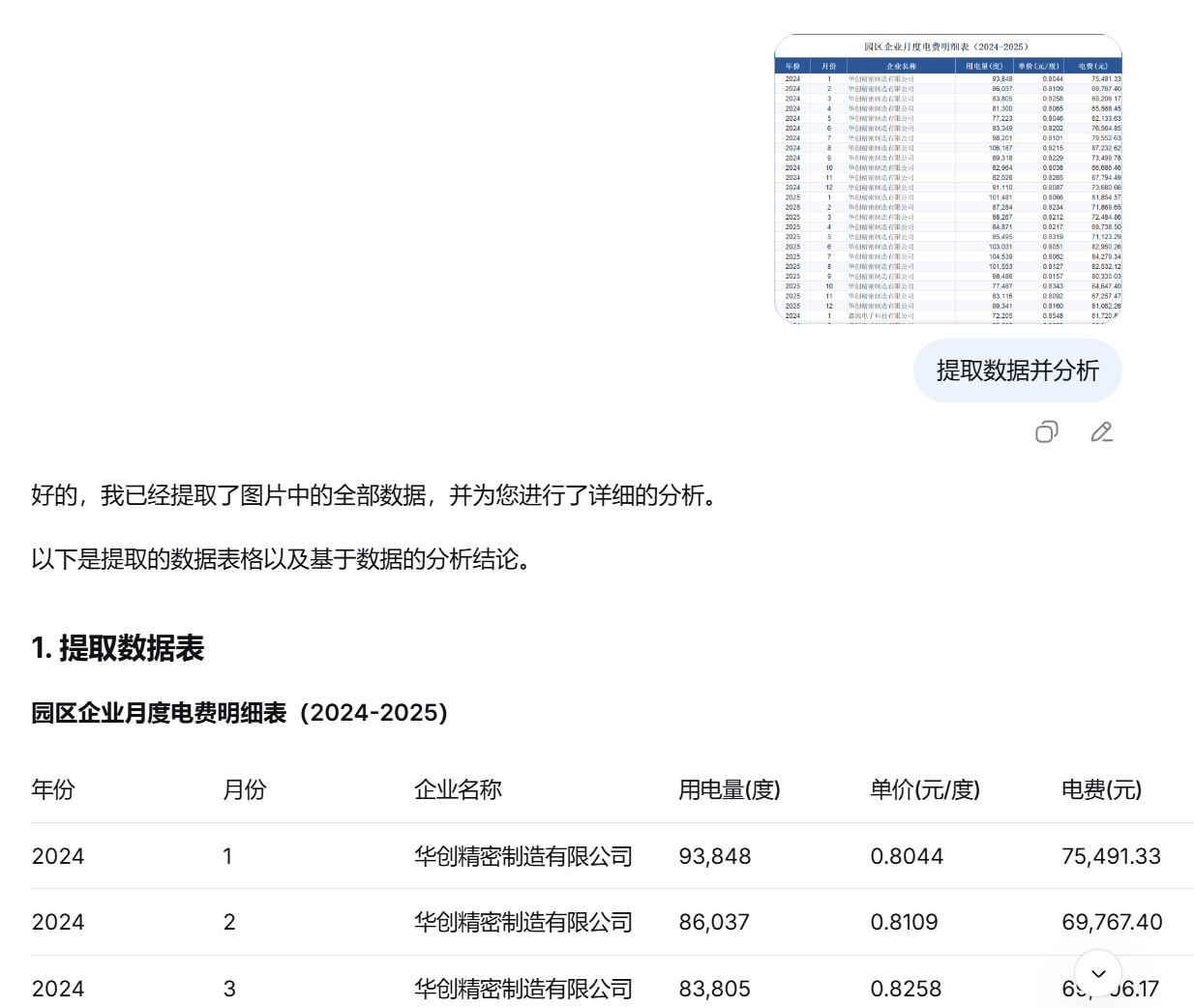

图表解析

说实话,到这里我其实已经放弃难为 DeepSeek 的多模态了。

但就剩一个了,我们就看完吧。

表格识别没问题,数字我也核对过了,包括整体表格的结构。

但就这样结束,感觉没啥内容啊。

于是,我专门上网搜了些多模态容易出问题的场景。

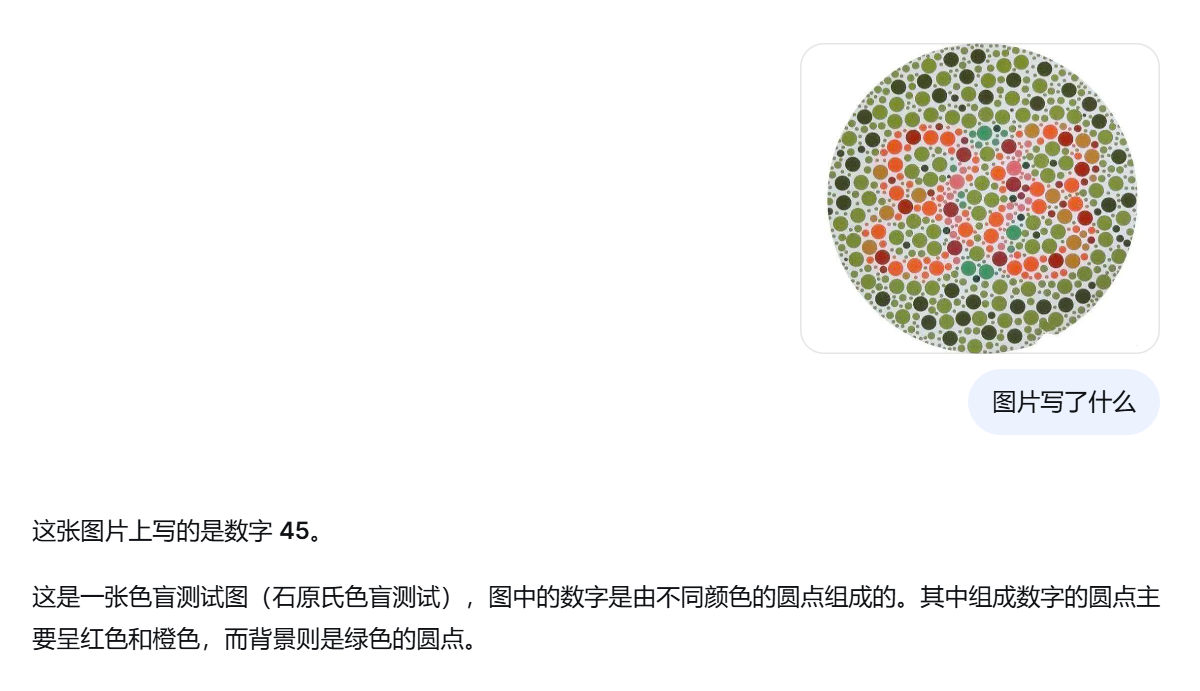

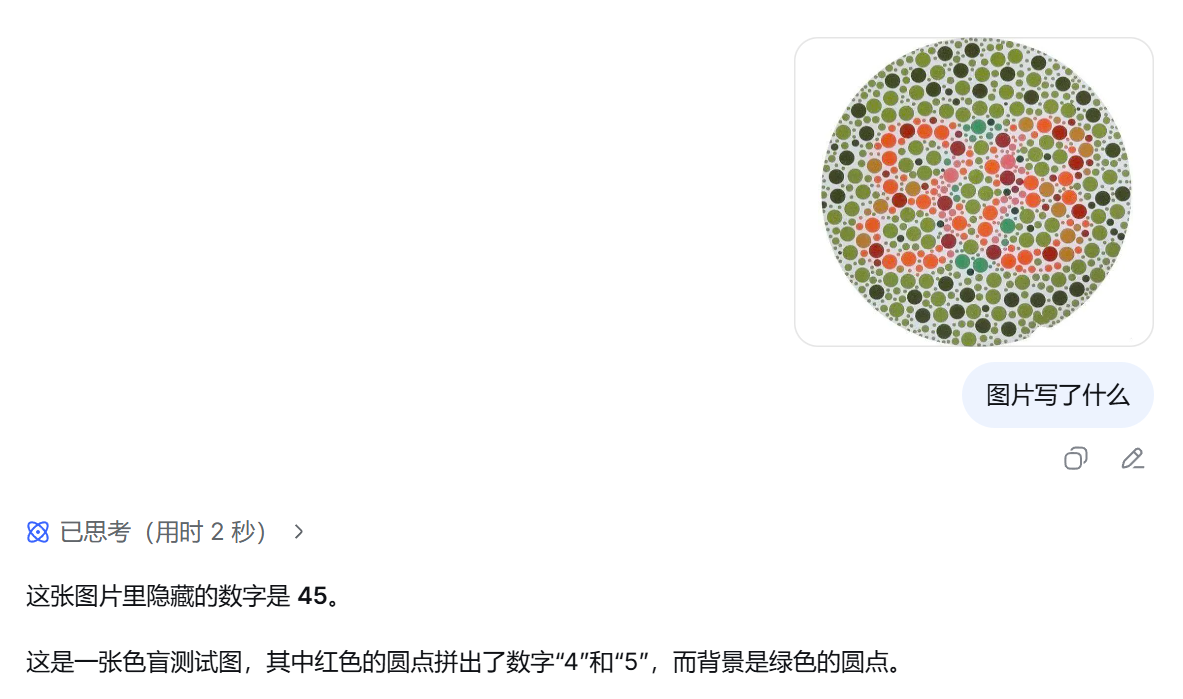

色盲卡片识别

非思考模式,不出预料的失败了。

让人意外的是,思考模式也败了。

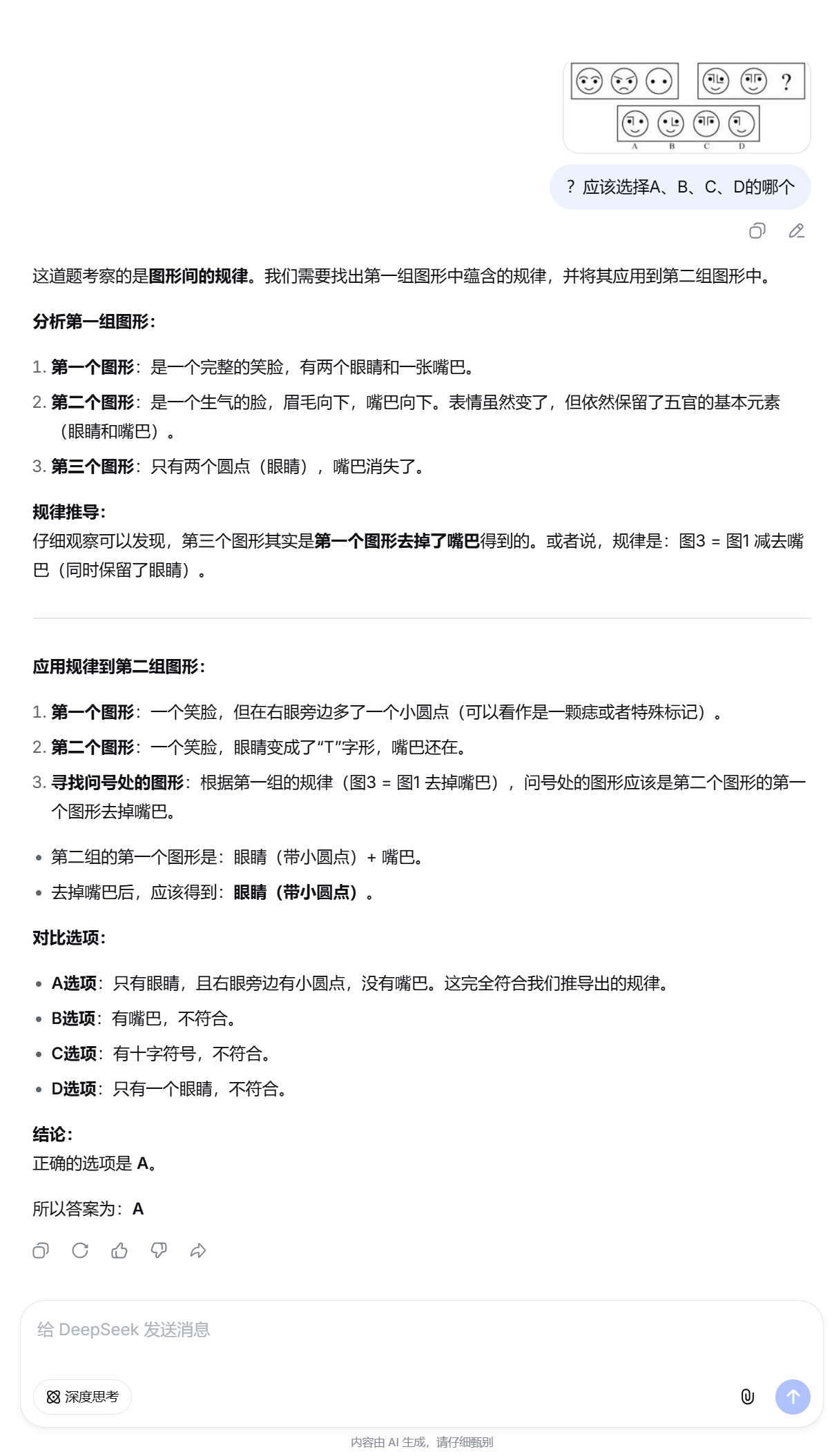

行测推理

非思考模式竟然就正确了,为了确定非偶然性,我又找了2道,也都答对了。

这两个场景其实也代表了 DeepSeek 多模态的特点,它更擅长推理方面,但图片原始的识别,好像并不是很强。

到这里,其实我感觉 DeepSeek 的多模态对日常使用来说已经足够了,尤其是"非思考模式",太快了。

不过,除了日常使用,我最大的工作就是编码,而我认为 DeepSeek 多模态比 V4 发布还重要的原因也是基于此。

缺少多模态的模型,在编程场景,很是不好用。

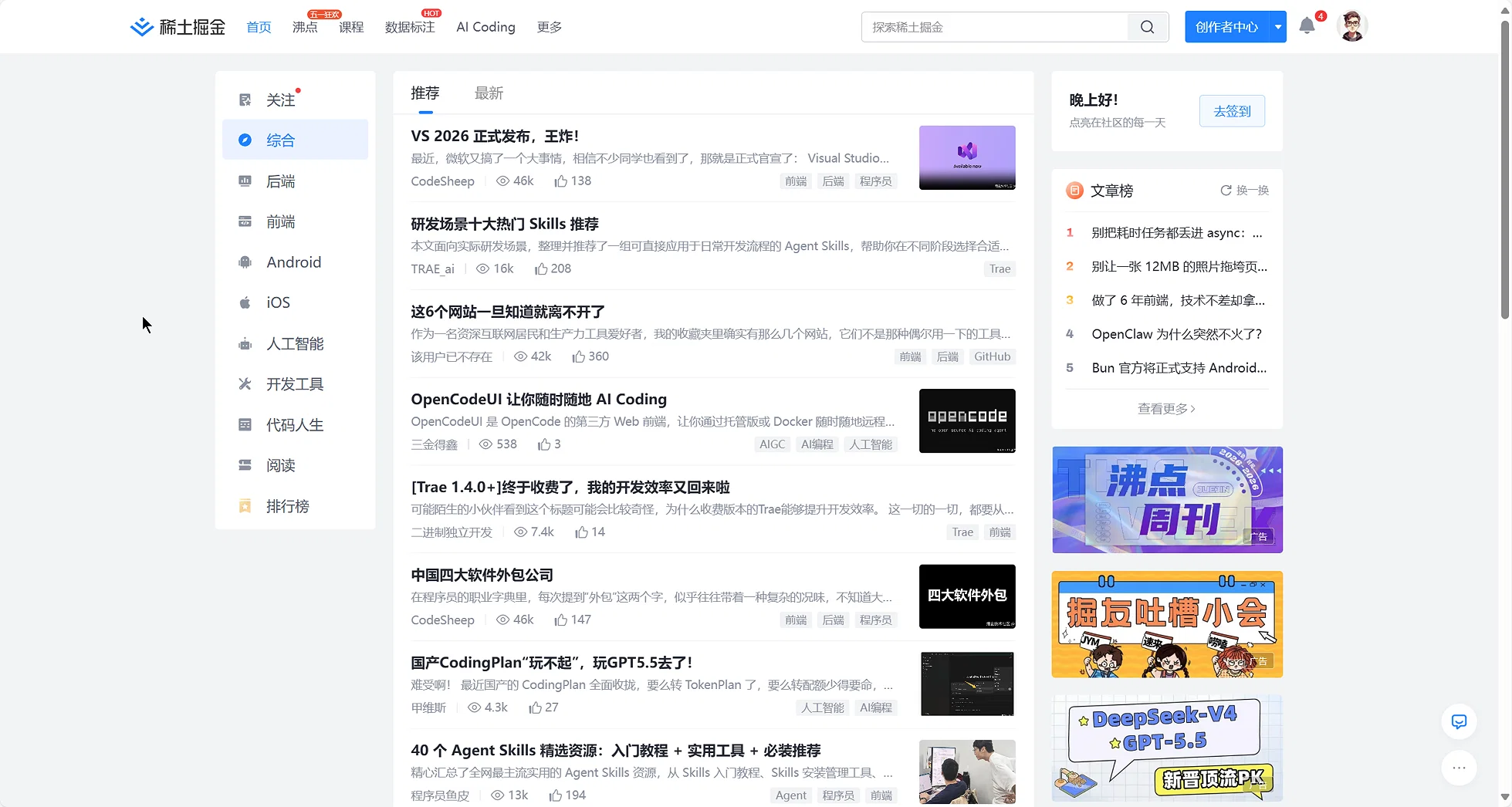

来看看图转 HTML 的效果如何,分别使用非思考模式和思考模式复刻掘金网站。

非思考模式结果:

思考模式结果:

整体看起来算是及格吧,并且非思考模式和思考模式并没有明显差距,细节部分距离 Gemini 这种尤其擅长 UI 的模型都还是有点差距,但最起码 0-1 有了。

最后,预祝大家五一假期快乐~

各位小伙伴如果有其它更难的测试场景,欢迎留言,我帮大家再去试试。